Falsa muerte de Angelique Boyer: alerta en México por fraudes con inteligencia artificial y clonación de voz

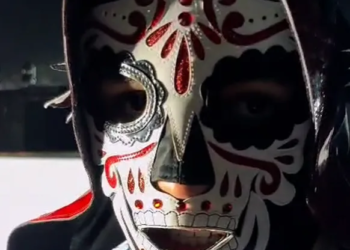

La supuesta muerte de la actriz Angelique Boyer, difundida en redes sociales a través de un video manipulado, no solo generó confusión entre miles de usuarios… también encendió una alerta sobre un fenómeno que ya está creciendo en México: el uso de inteligencia artificial para crear engaños cada vez más realistas.

Contenido

El caso se viralizó a partir de un audio falso que imitaba la voz del actor Sebastián Rulli, lo que llevó a muchas personas a creer que se trataba de un anuncio real. Sin embargo, la información fue desmentida y se confirmó que la actriz se encuentra bien, activa y sin problemas de salud.

De rumor viral a problema real

Aunque el caso parecía un simple engaño digital, especialistas advierten que este tipo de contenidos forman parte de una tecnología conocida como deepfakes, capaz de crear audios, imágenes o videos falsos con apariencia completamente real.

Hoy, estos contenidos ya no son bromas…

son herramientas utilizadas para manipular, engañar y hasta cometer delitos.

Así funciona la clonación de voz con inteligencia artificial

De acuerdo con autoridades y organismos financieros en México, los delincuentes pueden:

- Obtener fragmentos de voz de redes sociales, audios o llamadas

- Procesarlos con inteligencia artificial

- Replicar tono, ritmo y forma de hablar de una persona

Todo esto para crear mensajes falsos extremadamente creíbles.

Incluso, estudios científicos han demostrado que las personas no pueden detectar fácilmente audios falsos, lo que aumenta el riesgo de engaño.

El fraude que ya está ocurriendo: secuestros falsos con voces reales

Autoridades mexicanas han alertado sobre una modalidad alarmante:

- Delincuentes clonan la voz de una persona

- Llaman a sus familiares

- Simulan emergencias como secuestros, accidentes o robos

- Exigen dinero inmediato

Todo usando una voz que parece completamente real.

La Secretaría de Seguridad y Protección Ciudadana (SSPC) ha advertido que estos fraudes ya están en circulación y recomienda no compartir información ni responder llamadas sospechosas.

Cifras que muestran el crecimiento del problema

El fenómeno no es aislado, va en aumento:

- Más de 14 mil 397 casos relacionados con delitos con IA han sido atendidos por la Policía Cibernética en México entre 2020 y 2025

- Solo en 2025 se registraron 3,975 casos, la cifra más alta hasta ahora

- El fraude con deepfakes creció hasta 484% en México en el último año

- El 71% de los fraudes financieros ya ocurre en entornos digitales

Además, expertos advierten que 72% de las personas no logra identificar contenido falso, lo que facilita su viralización.

En estados turísticos como Quintana Roo, donde el uso de redes sociales y plataformas digitales es alto, el riesgo es aún mayor, especialmente en contextos de turismo, servicios y comunicación constante.

¿Y la ley? México va atrás de la tecnología

Aquí viene uno de los puntos más delicados:

En México, actualmente no existe una ley específica que castigue directamente los deepfakes o la clonación de voz con IA.

Aunque se pueden aplicar leyes existentes como:

- Fraude

- Suplantación de identidad

- Violencia digital (Ley Olimpia)

Estas no cubren completamente el alcance de esta nueva tecnología.

Especialistas coinciden en que legislar sobre deepfakes es complejo, debido a la rapidez con la que evoluciona la inteligencia artificial y la dificultad para identificar a los responsables.

Sin embargo, ya existen propuestas para regular el uso de IA en delitos digitales, aunque aún no han sido aprobadas a nivel federal.

Una línea que ya se cruzó

El caso de Angelique Boyer deja algo claro:

La inteligencia artificial ya no solo crea contenido…

Ahora puede suplantar identidades y construir realidades falsas

Lo que antes era una broma viral, hoy puede convertirse en:

- Extorsión

- Fraude

- Manipulación social

- Desinformación masiva

Y lo más preocupante:

Cada vez se necesita menos información para lograrlo.

Una advertencia para todos

La tecnología avanza más rápido que la regulación…

y también más rápido que la conciencia social.

Hoy cualquiera puede ser víctima:

- Con un audio en redes

- Con una llamada contestada

- Con un video publicado

Conclusión: ya no es el futuro, es el presente

La falsa muerte de Angelique Boyer no fue solo un rumor…

fue una muestra clara del nuevo escenario digital.

Un mundo donde:

- Las voces pueden ser clonadas

- Las imágenes pueden ser falsas

- Y la verdad puede ser manipulada

También te puede interesar: Tormentas eléctricas, calor intenso y vientos fuertes impactarán Quintana Roo este sábado

Sé el primero en comentar post